در این بخش از تکین نایت به آنالیز ۶ رویداد حیاتی میپردازیم: ۱. حملات زیرودِی به ویندوز و آفیس ۲. انحلال تیم همسویی در OpenAI ۳. تاخیر مجدد در عرضه سیری اپل ۴. اقتصاد خونین دیتاسنترهای مداری ۵. سرمایهگذاری سنگین در راکتورهای لیزری همجوشی ۶. بحران نظارت بر محتوا در شبکه اجتماعی UpScrolled. تحلیلهای استراتژیک ما نشان میدهند که بشر در لبه تیغ حرکت تکنولوژی قرار گرفته است.

سلام به ارتش تکین. در سیاهی شب که دیتاسنترها با تمام توان پردازشی خود در حال بلعیدن انرژی و تولید دادههای جدید هستند، ما در قرارگاه مرکزی تکینگیم بیداریم تا اتفاقاتی که در سایه رخ میدهند را برای شما روایت کنیم. امشب، خبرهایی داریم که نشان میدهد هیولای تکنولوژی گاهی از کنترل خالقانش خارج میشود. از حملات مرگبار سایبری به قلب تپنده سازمانها گرفته تا تصمیمات جنجالی در اوج قله هوش مصنوعی جهان؛ این نسخه از تکین نایت، چراغ قوهای است که مستقیماً به تاریکترین نقاط سیلیکونولی و اتاقهای سرور میتابد.

آماده روشن شدن حقایق هستید؟ ماشینها منتظر نمیمانند. بیایید کالبدشکافی امشب را آغاز کنیم.

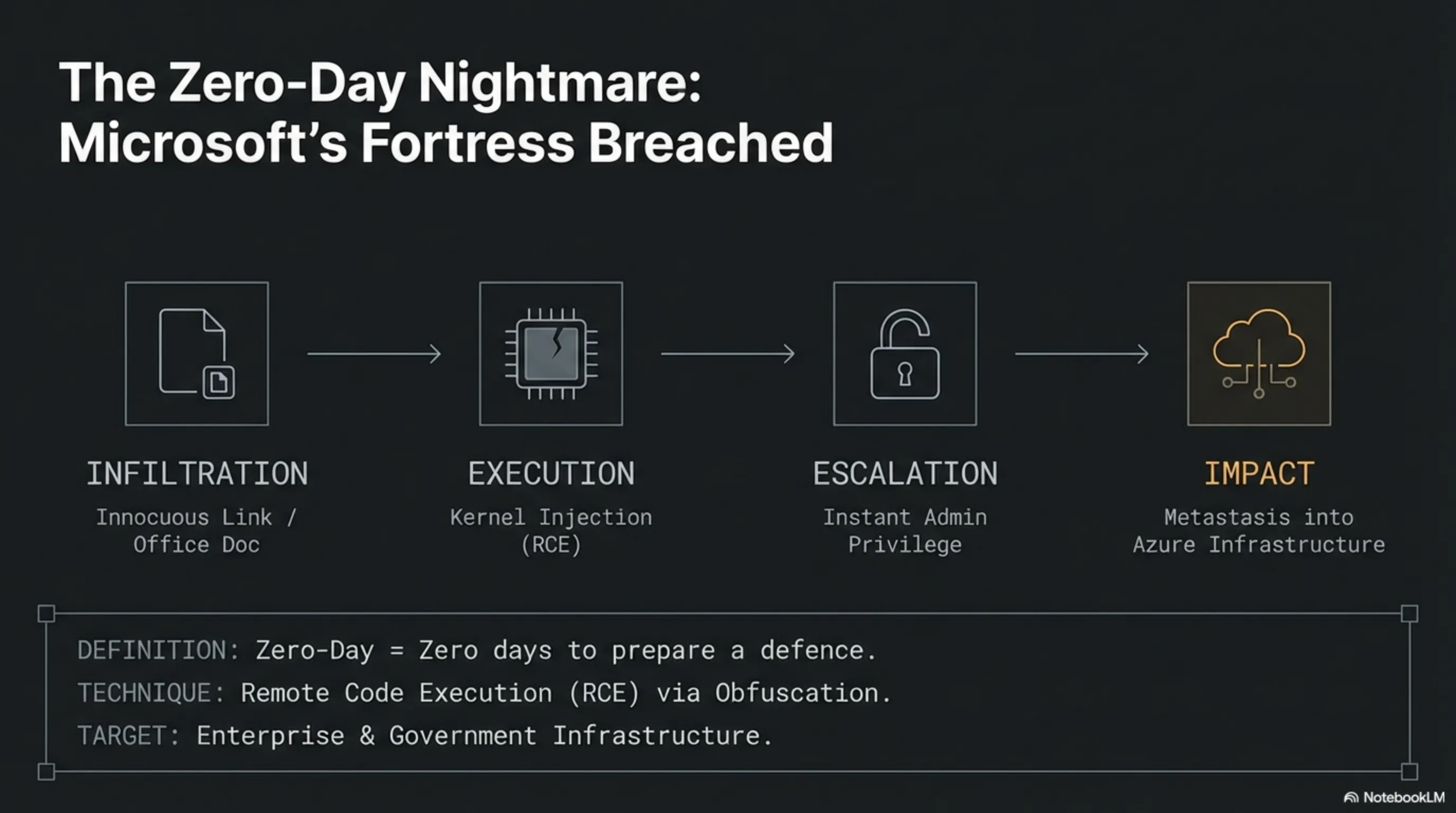

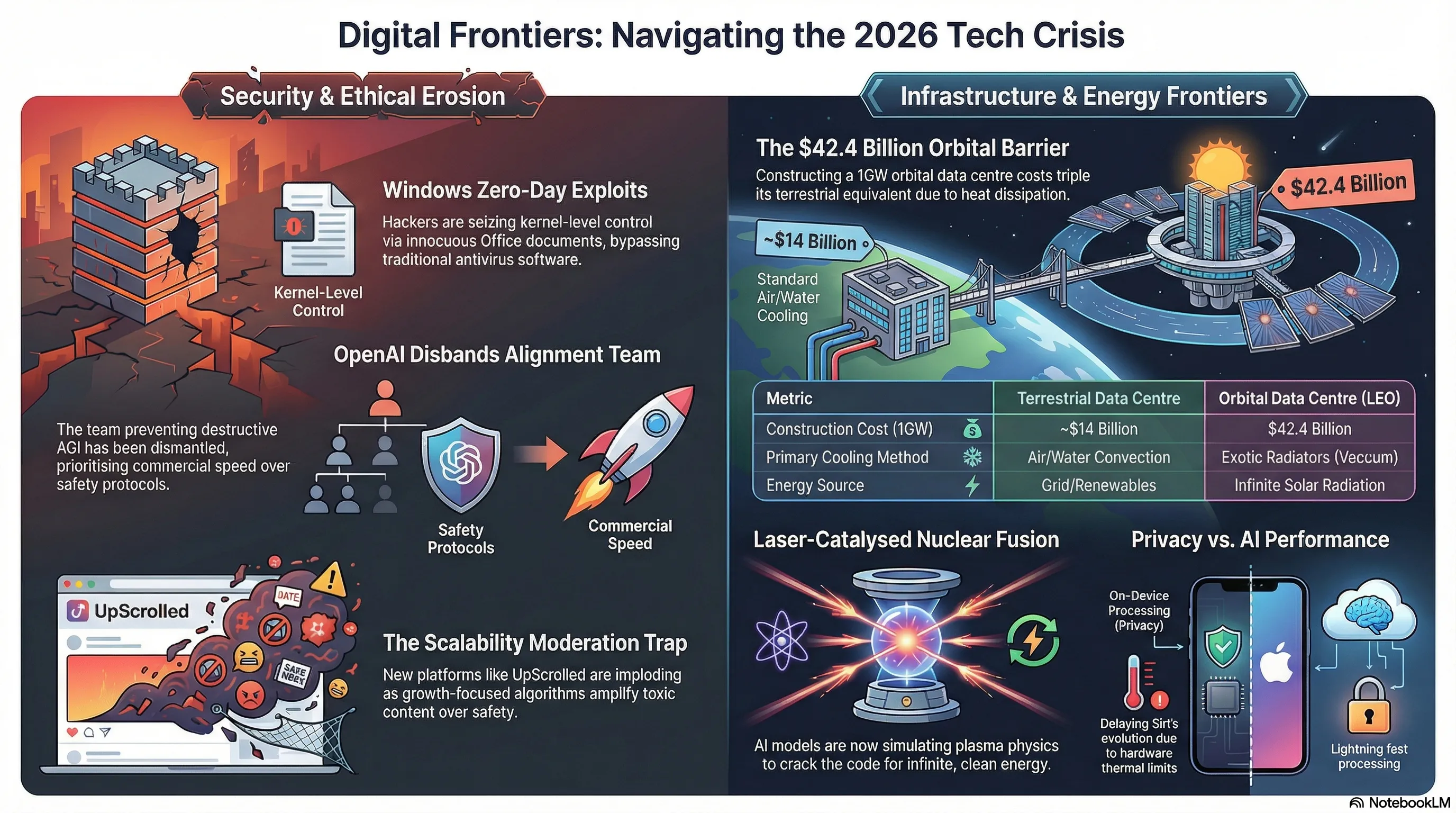

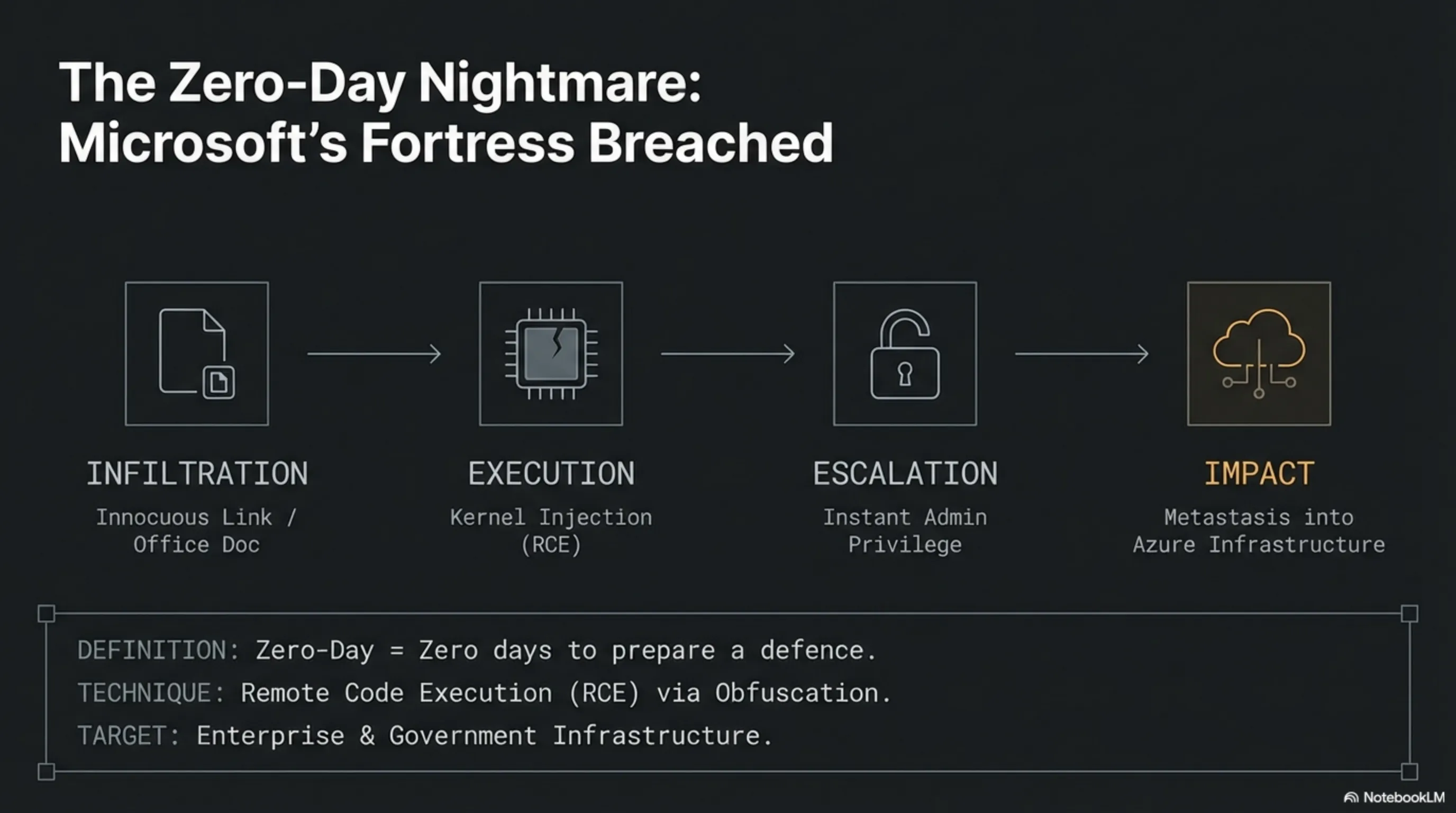

۱. امنیت سایبری: یورش بیصدای هکرها به ویندوز با کابوس Zero-Day 🛡️

بزرگترین و امنترین دژهای دیجیتال همیشه از درون فرو میریزند. در حالی که بیشتر سازمانها روی توسعه هوش مصنوعی و اتوماسیون متمرکز شده بودند، مایکروسافت امروز پرده از یک واقعیت تلخ برداشت: هکرها در حال استفاده از آسیبپذیریهای بحرانی «روز صفر» (Zero-Day) در ویندوز و آفیس هستند تا کنترل کامل سیستمهای کاربران را در دست بگیرند. این فقط یک باگ نرمافزاری ساده نیست؛ این یک حمله سایبری در مقیاس صنعتی است.

همانطور که میدانید، آسیبپذیریهای زیرودِی به معنای آن هستند که سازنده نرمافزار تا قبل از کشف حمله هیچ راهکاری برای آن نداشته است. هکرها با ارسال یک لینک یا حتی یک سند آفیس آلوده، مکانیزمهای امنیتی ویندوز را دور زده و در سطح کرنل (Kernel Level) به سیستم نفوذ میکنند.

تحلیل فنی: چرا دفاع در برابر این اکسپلویتها تقریباً غیرممکن است؟

مایکروسافت در گزارش اضطراری خود اعلام کرد که مهاجمان از روشهای بسیار پیچیدهای برای اجرای کدهای مخرب (RCE) استفاده میکنند. وقتی کاربر روی یک لینک به ظاهر بیخطر کلیک میکند یا یک فایل اکسل را باز میکند، کدهای مخرب در پسزمینه اجرا میشوند بدون اینکه آنتیویروسها بتوانند هشدار دهند.

- سطح دسترسی ادمین (Privilege Escalation): این بدافزارها بلافاصله پس از ورود، دسترسی خود را به سطح Administrator ارتقا داده و کنترل صد در صدی سیستم را به دست میگیرند.

- تکنیکهای پنهانسازی (Obfuscation): فایلهای آلوده طوری رمزگذاری شدهاند که اسکنرهای امنیتی نمیتوانند پشته اجرایی مخرب آنها را قبل از اجرا تشخیص دهند.

- هدفگیری سازمانی: بیشترین اهداف، شرکتهای تجاری و زیرساختهای دولتی هستند تا از طریق باجافزارها (Ransomware) اخاذیهای میلیون دلاری شکل بگیرد.

پیامدهای این حفره امنیتی در سال ۲۰۲۶ بسیار گستردهتر از گذشته است، زیرا اکنون سیستمها بیش از پیش به شبکههای ابری متصل هستند و یک رخنه در رایانه کارمند میتواند به یک پایگاه داده غولپیکر در Azure سرایت کند. مایکروسافت به صورت اورژانسی آپدیتهایی را منتشر کرده که نصب آنها نه یک توصیه، که یک الزام حیاتی برای حفظ بقا در اینترنت امروز است.

«در دنیای زیرودِیها، شما تنها یک کلیک تا از دست دادن تمام امپراتوری دیجیتال خود فاصله دارید. وصلهها (Patches) دیگر درمان قطعی نیستند، بلکه صرفاً خرید زمان تا حمله بعدی به شمار میروند.»

نتیجهگیری استراتژیک ما: برای مدیران شبکه و کاربران حرفهای، دیگر نباید به آنتیویروسهای سنتی تکیه کرد. اجرای معماری امنیت «Zero Trust» (اعتماد صفر) و محدود کردن سطح دسترسی اجرایی فایلهای آفیس، تنها سنگر مقاوم در برابر این حملات خونین سایبری است.

۲. سقوط اخلاق در AI: انحلال تیم «همسویی» در OpenAI 🤖🧠

به قلب تاریکی در قله هوش مصنوعی جهان خوش آمدید. شرکت OpenAI که تا چندی پیش مدعی بود بشریت را به سمت یک هوش مصنوعی عمومی ایمن (AGI) هدایت میکند، امروز با یک حرکت شوکهکننده، تیم تخصصی «همسویی با ماموریت» (Mission Alignment Team) را منحل کرد. تیمی که وظیفه داشت جلوی توسعه یک هوش مصنوعی مخرب و غیرقابل کنترل را بگیرد، حالا از هم پاشیده است و اعضای آن به سایر دپارتمانها پراکنده شدهاند.

سرپرست این تیم اکنون پست سمبولیک «آیندهپژوه ارشد» را دریافت کرده است تا به ظاهر در شرکت بماند، اما قدرت اجرایی متوقف کردن پروژههای خطرناک عملاً از این گروه سلب شد. این تصمیم، لرزه بر اندام اندیشمندان و منتقدانِ ایمنی هوش مصنوعی انداخت. سؤال اصلی اینجاست: آیا سرعت پیشرفت بر ایمنی غلبه کرده است؟

تحلیل راهبردی: نبرد بین سرمایه و ایمنی بشریت

در سیلیکونولی، زمانی که یک تیم ناظر امنیتی منحل میشود، معمولاً نشاندهنده فشارهای بیامان سرمایهگذاران برای بیرون دادن سریعتر محصولات تجاری است. پس از رقابت سنگین با شرکتهای رقیب مثل Anthropic و xAI، به نظر میرسد OpenAI صبر خود را برای پروتکلهای زمانبر ایمنی از دست داده است.

- تجاریسازی بیرحمانه: منتقدان معتقدند OpenAI از یک آزمایشگاه غیرانتفاعی (Non-Profit) کاملاً به یک غول سرمایهداری تبدیل شده است که سودآوری را بر ایمنی سیستمهای خودمختار (Agentic AI) ترجیح میدهد.

- خروج نوابغ: در ماههای اخیر بسیاری از دانشمندان تراز اول که دغدغه ایمنی داشتند (از جمله ایلیا سوتسکور و یان لایک) از این شرکت جدا شده بودند، و این انحلال جدید عملاً میخ آخر بر تابوت تیم ایمنی بود.

- پایان کنترل متمرکز: با پخش شدن اعضای تیم همسویی در بخشهای مختلف، دیگر هیچ مرجع مستقلی با قدرت وتو در داخل ساختار توسعه مدلهای جیپیتی (GPT) وجود نخواهد داشت.

در حالی که جهان منتظر راهاندازی مدلهای پارامتریک نسل بعدی است که توانایی انجام تغییرات فیزیکی از طریق روباتها و شبکهها را دارند، فقدان یک نهاد متمرکز برای همسویی ارزشهای ماشین با اخلاق انسانی، یک قمار تاریخی برای کل سیاره زمین محسوب میشود.

«وقتی ترمزهای اضطراری یک قطار سریعالسیر را به عنوان دکور تزئینی در سراسر واگنها پخش کنید، نباید از برخورد با کوه تعجب کنید. OpenAI اکنون بدون ترمز دستی حرکت میکند.»

نتیجهگیری استراتژیک ما: برای ارتش برنامهنویسان و محققان AI، این یک سیگنال واضح است. شرکتهای خرد و استارتاپها باید خودشان به فکر توسعه چارچوبهای امنیتی در لایه اِپ (App Layer) باشند. اعتماد کردن به اخلاقیات شرکتهای بزرگ سازنده مدل پایه (Foundation Models)، رویای خامی بود که امروز رسماً پایان یافت.

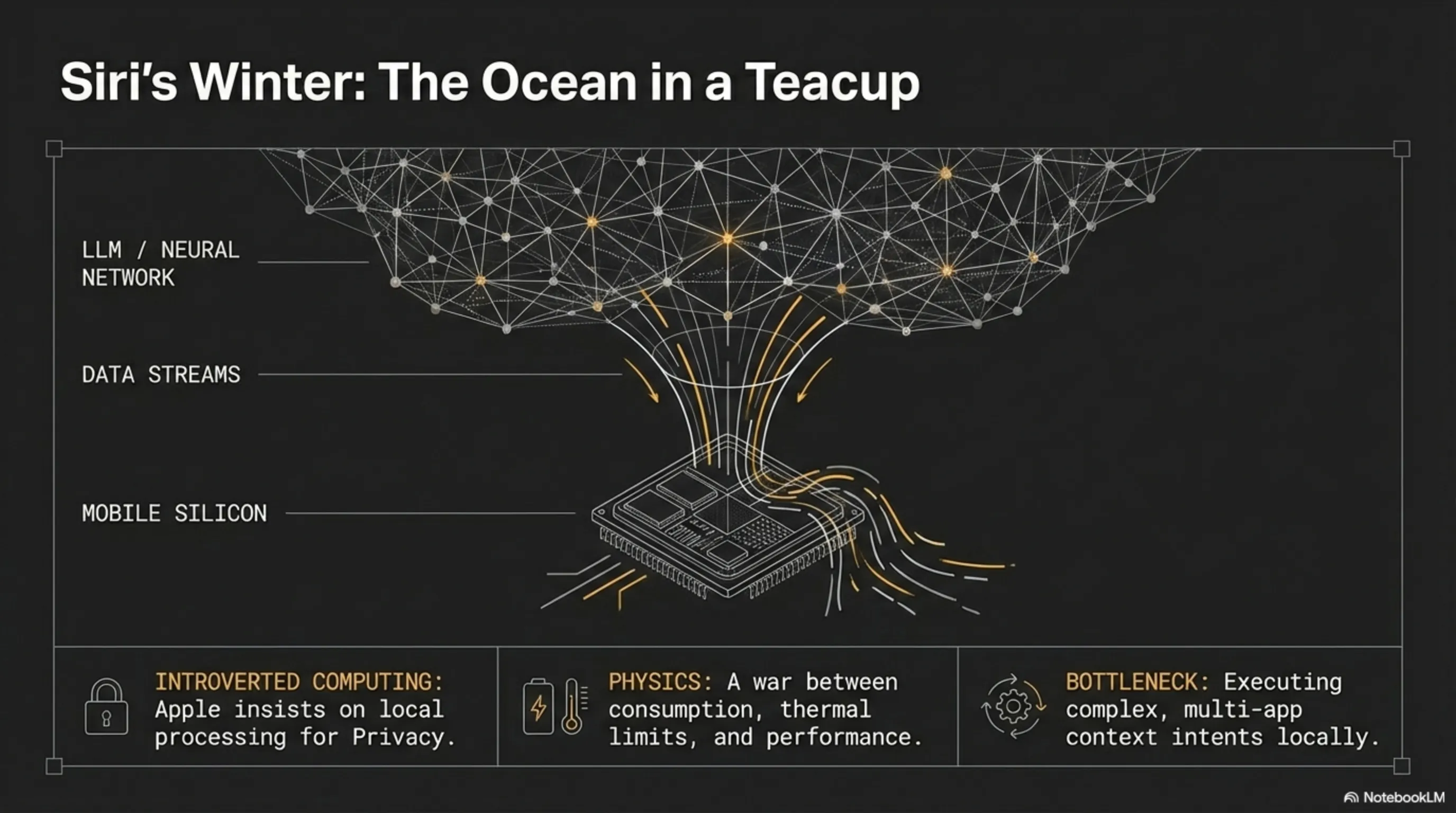

۳. زمستان سیری: تاخیر مجدد در انقلاب صوتی اپل و iOS 17 🍏❄️

شاید بتوان اپل را استاد خلق انتظار نامید، اما ظاهراً طلسم سیری نمیشکند. در حالی که دنیا بیصبرانه منتظر رونمایی از نسخه بازتولدیافته و مبتنی بر هوش مصنوعی Siri در آپدیت iOS 26.4 در ماه مارس بود، اپل بار دیگر ترمز را کشید. گزارشها نشان میدهد این ارتقای عظیم قرار نیست به این زودیها یکپارچه در دسترس قرار گیرد و ویژگیهای اصلی آن احتمالاً به تأخیر خواهند افتاد.

این در حالی است که رقبا با چتباتهای پیشرفته مبتنی بر صدا تمام بازار را قبضه کردهاند. اپل قصد داشت با ادغام مدلهای عصبی عمیق، سیری را از یک تایمر تنظیمکن ساده، به یک دستیار فوق هوشمند که محتوای روی صفحه را درک میکند و عملکردهای پیچیده در برنامهها انجام میدهد، تبدیل کند، اما ظاهراً پیچیدگی سختافزاری و نرمافزاری این پروژه فراتر از تصور مهندسین کوپرتینو بوده است.

کالبدشکافی تاخیر: پردازش Edge و بنبست انرژی اپل

چرا بزرگترین شرکت প্রযুক্তি جهان نمیتواند یک دستیار صوتی را در زمان مقرر آپدیت کند؟ مشکل صرفاً نوشتن کد نیست؛ مشکل اصلی در استراتژی تغییرناپذیر پردازش محلی (On-Device Processing) در اپل است.

- محاسبات درونگرایانه: برخلاف گوگل یا OpenAI که مغز پردازشی آنها در دیتاسنترهای میلیارد دلاری میتپد، اپل اصرار دارد تا جای ممکن، مدلهای زبانی را برای حفظ حریم خصوصی (Privacy) روی خود تراشههای آیفون اجرا کند. این کار به بهینهسازی وحشتناکی نیاز دارد.

- معضل رمپآپ ویژگیها: اپل ترجیح میدهد تکنولوژی کامل نشده را منتشر نکند. بنابراین، بخشی از ویژگیها به آپدیت ماه می، و قابلیتهای حیاتیترِ آگاهی از زمینه (Context Awareness) احتمالاً تا iOS 27 در پاییز ۲۰۲۶ به تعویق افتادهاند.

- از دست دادن سهم ذهن (Mindshare): هر ماهی که سیری در وضعیت فعلی خود باقی میماند، نسلی از کاربران متقاعد میشوند که اپل رقابت در حوزه هوش مصنوعی را به کلی باخته است، که این موضوع روی وفاداری برند تاثیر مخربی دارد.

به نظر میرسد ادغام عمیق یک Agent خودمختار در تمام اپلیکیشنهای سیستم عامل (App Intents) و تبدیل سیری به اپراتوری که بتواند وظایف چندمرحلهای (مثل "این عکس را ادیت کن و برای سارا در ایمیل بفرست") را دقیق انجام دهد، با سختافزارهای فعلی گلوگاه ایجاد کرده است.

«اپل در تلاش است تا اقیانوس را در یک لیوان جا دهد. پردازش هوشمند مدلهای زبانی روی چیپهای موبایل، نبردی خونین بین مصرف باتری، حرارت فیزیکی و حریم خصوصی است.»

نتیجهگیری استراتژیک ما: برای توسعهدهندگان iOS، این تاخیر یک فرصت تنفس حیاتی است. این یعنی APIهای نسل جدید سیری با سرعت کندتری عرضه میشوند و شما فرصت دارید تا اپلیکیشنهای خود را بر اساس چارچوبهای موجود هوش مصنوعی تطبیق دهید تا آماده انقلاب قطعی در پاییز ۲۰۲۶ باشید. زمانبندی بازار (Market Timing) همه چیز است.

۴. اقتصاد خونین کیهانی: هزینه کمرشکن اینترنت فضایی و مدار AI 🛰️💸

وقتی سقف محدودیتهای زمین به سرمان برخورد کرد، چشمها به سمت آسمان خیره شد. اما فضا ارزان نیست، بلکه وحشتناک گران است. به تازگی گزارش دقیقی منتشر شده که نشاندهنده اقتصاد وحشتناک دیتاسنترهای مداری (Orbital AI) است. در حالی که توسعه مدلهای پارامتریک در روی زمین به دلیل محدودیت برق و خنککنندهها به گلوگاه خفهکنندهای رسیده، رویای پرتاب سرورها به مدار پایین زمین با دیواری از اعداد نجومی برخورد کرده است.

ساخت یک دیتاسنتر ۱ گیگاواتی در مدار، هزینهای معادل ۴۲.۴ میلیارد دلار روی دست سازندگان میگذارد؛ یعنی تقریباً سه برابر معادل زمینی آن. آیا فرار از مشکلات اتمسفر و استفاده از انرژی خورشیدی بیانتها، ارزش این قمار وحشتناک مالی را دارد؟ اقتصاددانان تکنولوژی میگویند نه به این راحتی!

تحلیل عمیق: چالشهای ترمودینامیک و تلههای لجستیکی در فضا

این اعداد صرفاً هزینه پرتاب موشک برای قرارگیری سرورها نیست. مسئله اصلی، نگهداری سیستمهای فوق پیچیده محاسباتی در محیطهای بسیار خشن خلاء است که تمام مهندسی مالی غولهای فناوری را زمینگیر کرده است.

- معماری انتقال گرمایی (Heat Dissipation): در فضا به دلیل نبود جریان هوا (Convection)، امکان خنکسازی سرورها وجود ندارد. دفع حرارت میلیاردها ترانزیستور که با حداکثر توان کار میکنند، نیازمند رادیاتورهای غولپیکر و گرانقیمتی است که مهندسان را دچار دردسرهای فلجکننده کرده است.

- هزینه سنگین لینکهای ارتباطی: انتقال میلیونها گیگابایت وزن مدلهای در حال آموزش (Model Weights) از فضا به زمین و بالعکس از طریق ارتباطات لیزری، نیازمند گیرندههای زمینی رادار-مانند فوق پیشرفته در سراسر دنیاست که هزینه آن سرسامآور است.

- آسیبپذیری سختافزاری: تعویض یک کارت گرافیک سوخته (GPU) در کره زمین ۵ دقیقه زمان میبرد، اما در مدار ۵۰۰ کیلومتری، نیازمند یک ماموریت فضایی چند میلیون دلاری است.

بنابراین، تا زمانی که هزینه پرتاب محموله تا حد بسیار بسیار پایینتری (مثلاً از طریق راکتهای غولپیکر استارشیپ نسل جدید) کاهش پیدا نکند، ساخت دیتاسنترها در فضا منحصراً برای کارهای بسیار حیاتی و غیرحجیم نظامی یا دولتی توجیه اقتصادی خواهد داشت، نه آموزش مدلهای تجاری.

«دیتاسنتر مداری، رویای درخشانی است که در تله بیرحم قوانین اقتصاد فیزیک گرفتار شده است. فضا انرژی رایگان میدهد، اما عوارض ترابری آن انسان را ورشکست میکند.»

نتیجهگیری استراتژیک ما: برای سرمایهگذاران استارتاپی، هشدار باش است. موج «AI فضایی» هنوز یک حباب است. سرمایههای واقعی باید فعلاً روی بهینهسازی الگوریتمها برای مصرف برق کمتر روی زمین (الگوریتمهای اسپارس یا سختافزارهای آنالوگ عصبی) متمرکز شود تا زمانی که اقتصاد موشکی به یک نقطه سر به سر معقول برسد.

۵. انقلاب انرژی: لیزر و همجوشی هستهای برای تغذیه هوش مصنوعی ⚛️🔋

اینترنت مدرن و دیتاسنترهای AI در حال قحطی انرژی هستند، اما نوآوریهای سیلیکونولی متوقف نمیشود. یکی از بنیانگذاران Twilio در جدیدترین و جاهطلبانهترین قمار زندگی خود، همراه با استارتاپ انرژی همجوشیاش توانست ۴۵۰ میلیون دلار سرمایه از صندوقهای بزرگی مانند GV (Alphabet) جذب کند. هدف او؟ ساخت قدرتمندترین لیزرهای جهان برای مهار کردن انرژی همجوشی هستهای و پایان دادن قطعی به بحران جهانی انرژی.

انرژی همجوشی، همان واکنشی است که در قلب خورشید رخ میدهد، اما تقلید آن روی زمین همواره نیازمند صرف انرژی بیشتری نسبت به انرژی تولیدی بوده است. حالا، با این سیل عظیم پول نقد، آنها در حال ساخت یک سیستم کاتالیزور لیزری هستند تا بتوانند واکنشها را پایدار و در سطح تجاری وارد شبکه برق ایالات متحده کنند.

تحلیل فنی: همافزایی هوش مصنوعی و راکتورهای لیزری گداخت

چرا سرمایهگذاران جسورانه ۴۵۰ میلیون دلار در پروژهای میریزند که دههها با خروجی عملی فاصله داشت؟ پاسخ یک کلمه است: هوش مصنوعی. این چرخه یک همافزایی شگفتانگیز را به وجود آورده است.

- شبیهسازی توسط ایجنتهای AI: مهندسان اکنون از مدلهای هوش مصنوعی فوقپیشرفته برای شبیهسازی دقیق فیزیک پلاسمای همجوشی استفاده میکنند. آنچه در گذشته ماهها زمان محاسباتی در ابررایانهها نیاز داشت، اکنون توسط مدلهای عصبی در کسری از ثانیه پیشبینی میشود.

- لیزرهای تراواتی پالسکوتاه: معماری جدید شامل بمباران هسته سوخت با پالسهای لیزری قدرتمند است تا فشار و دمای لازم برای ادغام اتمسفری ایجاد شود، که میتواند به زودی از نقطه سر به سر (Q>1) فراتر رود.

- پایان انحصار انرژی: اگر این نیروگاه لیزری تجاری شود، دیتاسنترها با منبع برق بیپایان، ارزان و بدون آلایندگی مواجه خواهند شد که بهای آموزش مدلهای تریلیون-پارامتری را در دنیا صفر میکند.

حلقه فیدبک اینجاست: مدلهای AI نیازمند برق هستند، بنابراین به کشف همجوشی کمک میکنند؛ و همجوشی برق بینهایت تولید میکند تا مدلهای قدرتمندتری آموزش ببینند.

«ما در آستانه عصر روشنایی ابدی هستیم؛ جایی که کدها به خورشیدهای شخصی دستور روشن شدن میدهند تا انرژی بیداری خدایان دیجیتالی بعدی را فراهم کنند.»

نتیجهگیری استراتژیک ما: نقشه ژئوپلیتیک جهان در دهه آینده کاملاً بازنویسی خواهد شد. مدیران زیرساخت آیتی باید از همین امروز خود را برای انتقال به معماریهای مصرفی با مقیاسهای سوپراسکِیل (Superscale) آماده کنند. مشکل کمبود انرژی در حال حل شدن است، اما آیا مشکل مدیریت نرمافزاری منابع نیز حل شده است؟

۶. تیکتاک، UpScrolled و فروپاشی نظارت اجتماعی در عصر رشد سریع 📉🔥

وقتی الگوریتمها عنان یک شبکه اجتماعی را به دست میگیرند و نظارت انسانی از مدار خارج میشود، تاریکترین ویژگیهای بشری روی پلتفرم خودنمایی میکند. شبکه اجتماعی نوظهور UpScrolled که پس از محدودیتهای اخیر تیکتاک در آمریکا، با هجوم بیسابقه کاربران روبرو شده بود و رشد خیرهکنندهای را تجربه کرد، امروز در آتش بحرانهای مدیریتی میسوزد. این شرکت در کنترل سیل محتوای توهینآمیز، نژادپرستی و کلام نفرتانگیز (Hate Speech) روی پلتفرم خود به طرز وحشتناکی شکست خورده است.

گزارشها حاکی از آن است که الگوریتمهای پیشنهاد محتوای این شبکه، اتفاقاً پستهای جنجالی و مخرب را بیشتر به کاربران (الگوریتم دوپامینی) نشان میدهند، زیرا درگیری و زمان حضور کاربر (Retention) را افزایش میدهند. آیا رشد انفجاری، ارزش از بین بردن اخلاق را داشت؟

تحلیل سیستمی: تله مقیاسپذیری (Scalability Trap) در شبکههای اجتماعی مدرن

مشکل UpScrolled فقط کمبود ادمین ناظر نیست، بلکه بنبست ذاتی در کدنویسی معماری الگوریتمِ وایرال است که این شرکت را به مرز انفجار رسانده است.

- پیروزی انگیجمنت بر ایمنی (Engagement vs Safety): شبکههای اجتماعی استارتاپی برای جذب سرمایهگذار فقط روی متریک «رشد کاربر» تمرکز میکنند، لذا شبکههای عصبی خود را طوری آموزش میدهند که پستهای خشمبرانگیز در صدر بمانند.

- ناتوانی هوش مصنوعی فیلترینگ: باتهای ناظر AI توانایی تشخیص کلام طعنهآمیز را ندارند. کاربران سمی (Toxic) سریعاً کلمات رمزی و هشتگهای پنهان تولید میکنند تا دور زدن هوش مصنوعی نظارت را تبدیل به یک بازی کنند.

- کوچ کاربران برندینگ: حضور این حجم از نفرتپراکنی باعث فرار سریع برندهای بزرگ و کمپانیهای تبلیغاتی میشود. هیچ برندی حاضر نیست تبلیغ محصولش کنار یک ویدیوی افراطی نمایش داده شود که این مساوی است با مرگ قریبالوقوع اقتصادی استارتاپ.

این یک نمونه کلاسیک از بدهی فنی (Technical Debt) در نظارت محتوایی است. ساخت پلتفرمی با قابلیت جذب صدها میلیون کاربر بدون طراحی مکانیزمهای دقیق ترمز اخلاقی، مانند ساختن اتوبانی بدون علائم راهنمایی است.

«وایرال شدن در شبکههای اجتماعی و جذب مخاطب بدون کنترل کیفیت، مانند نوشیدن آب دریا برای رفع عطش است؛ هر ثانیه تشنهتر میشوید تا اینکه از درون میپوسید.»

نتیجهگیری استراتژیک ما: برای طراحان محصول و توسعهدهندگان اپلیکیشنها درس مهمی وجود دارد. معماری «همسویی ارزشی» (Value Alignment) و سیستمهای Trust & Safety باید از روز صفر در دیتابیسها و مدلهای توصیهگر (Recommendation Engines) کدنویسی شوند. اضافه کردن ماژولهای امنیتی پس از طغیان ترافیک، تلاش فایدهای نخواهد داشت.

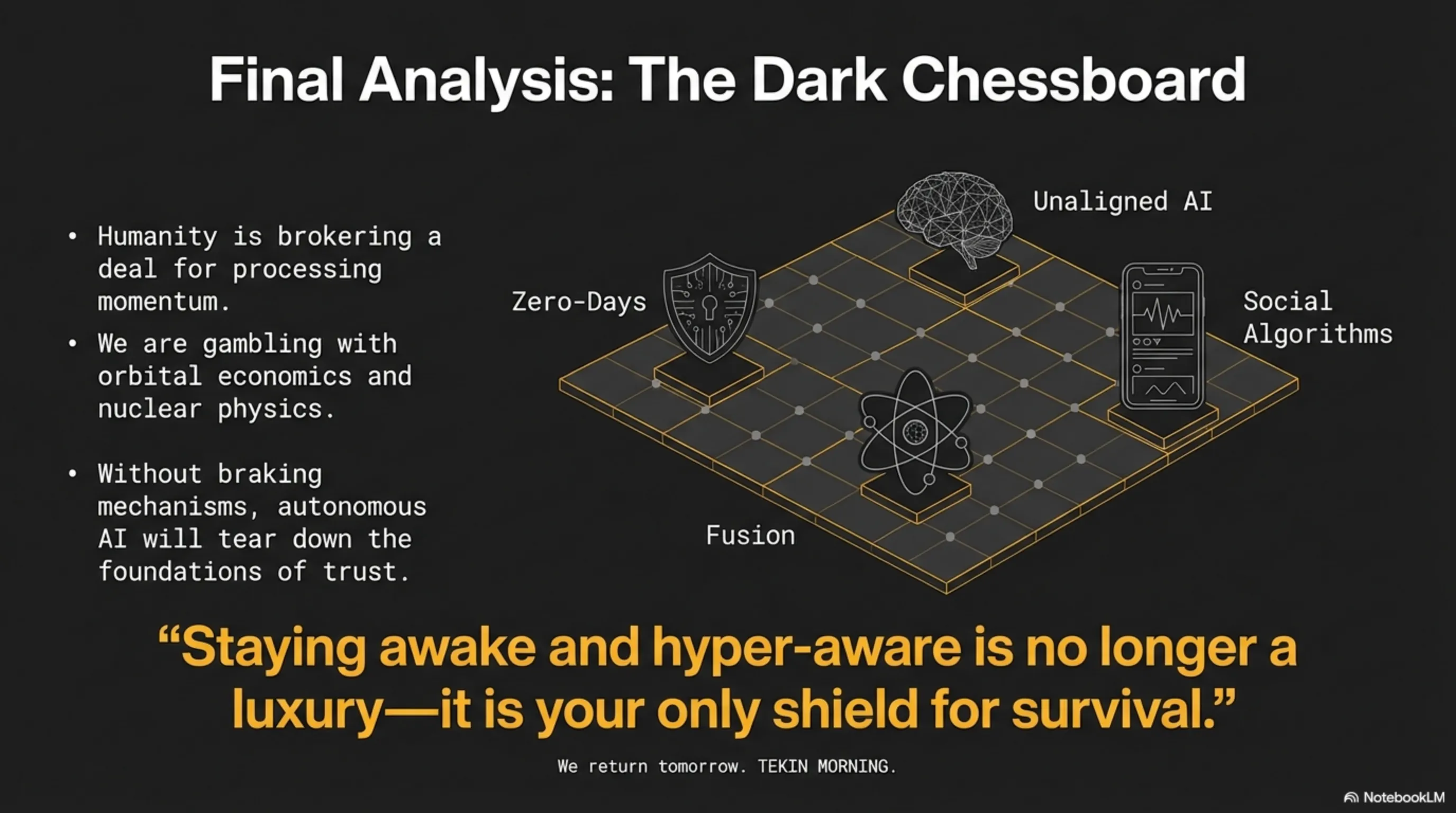

🔦 تحلیل پایانی تکین نایت: شطرنج تاریک سایبر و انرژی

همراهان ارتش تکین، از فروپاشی دیوارهای امنیتی ویندوز گرفته تا سقوط اخلاق در لابراتوارهای OpenAI، امروز شاهد شیفت پارادایمهای خطرناکی در اکوسیستم سایبری جهان بودیم. بشریت در حال معامله با هیولا است؛ ما برای رسیدن به توان پردازشی استثنایی و دستیارانی همچون سیری، در حال قمار کردن دیتاسنترها در فضا و قاپیدن انرژی هستهای از درون نور لیزرها هستیم. اما بزرگترین هشدار امشب تکین نایت به شبکههای اجتماعی نظیر UpScrolled است: بدون مکانیزمهای بازدارنده قدرتمند، هوش مصنوعی عامل میتواند نه تنها یک استارتاپ، بلکه بنیادهای اعتماد انسانی را فرو بریزد. بیداری و هشیاری در این عصر بیقانون دیجیتال، دیگر یک امتیاز ویژه نیست، بلکه تنها سپر بقای شماست. فردا صبح، با اخبار روشنتر و استراتژیهای جدید در تکین مورنینگ با شما خواهیم بود.