۱. معماری عطش: چرا هوش مصنوعی به این حجم وحشتناک از حافظه نیاز دارد؟

برای درک عظمت بحران ذخیرهسازی در اواسط دهه جاری، باید مکانیسم عملکرد مدلهای هوش مصنوعی در سال ۲۰۲۶ را به دقت تحلیل کنیم. در نسلهای قبلی هوش مصنوعی، دغدغه اصلی مهندسان تامین توان پردازشی خام (Compute Bound) بود. اما با ظهور سیستمهای هوش مصنوعی چندوجهی (Multimodal)، گلوگاه سیستم از پردازنده به حافظه (Memory Bound) منتقل شده است. این مدلها به طور همزمان متن، صدا، تصویر، ویدیوهای 8K و دادههای فضایی (Spatial Data) را پردازش میکنند. حجم ورودیهای این سیستمها به قدری بزرگ است که دیگر نمیتوان آنها را به صورت موقت نگهداری کرد.

اولین و شاید مخربترین عامل این عطش، فرآیند تولید دادههای مصنوعی (Synthetic Data) است. از آنجا که اینترنت دیگر دادهی متنی و ویدیویی باکیفیتِ جدیدی برای آموزش مدلهای پیشرفتهتر (مانند GPT-5 یا Gemini 2.0) ندارد، شرکتهای هوش مصنوعی مجبورند مدلهایی بسازند که وظیفهشان صرفاً تولید داده برای آموزش مدلهای دیگر است. یک کلاستر هوش مصنوعی ممکن است در یک هفته، دهها پتابایت ویدیوی آموزشی تولید کند. این دادهها مصرفشدنی نیستند؛ بلکه باید برای سالها در آرشیوهای امن نگهداری شوند تا در فرآیند یادگیری تقویتی (Reinforcement Learning) و ارزیابی کیفیت مدلها بارها بازخوانی شوند. حذف این دادهها به معنای از بین بردن پایههای دانش مدل است.

عامل دوم، معماری RAG (Retrieval-Augmented Generation) است که اکنون ستون فقرات زیرساختهای هوش مصنوعی سازمانی محسوب میشود. برای جلوگیری از «توهم» (Hallucination) در هوش مصنوعی، مدلها به پایگاهدادههای برداری (Vector Databases) عظیمی متصل میشوند که شامل تریلیونها توکن از اسناد قانونی، پزشکی، مالی و تحقیقاتی است. این سیستمها دائماً در حال ایندکس کردن اطلاعات جدید هستند. دسترسی مداوم و بلادرنگ به این پایگاهدادهها نیازمند ذخیرهسازی دائمی، ایمن و قابل گسترشی است که حجم آن به صورت تصاعدی بالا میرود.

در نهایت، مسئلهی "چکپوینتگیری" (Checkpointing) در زمان آموزش مدلهای عظیم (LLMs) مطرح است. آموزش یک مدل تریلیون پارامتری ماهها طول میکشد و نیازمند هماهنگی دهها هزار پردازنده گرافیکی است. برای جلوگیری از از دست رفتن پیشرفت در صورت قطعی برق، خرابی سختافزار یا خطاهای شبکه، سیستم باید هر چند ساعت یکبار وضعیت کامل پارامترهای مدل (Weights, Biases, Optimizer States) را در حافظه فیزیکی ذخیره کند. هر چکپوینت از یک مدل پیشرفته میتواند دهها ترابایت حجم داشته باشد و در طول دوره آموزش، هزاران چکپوینت ایجاد میشود. ترکیب این سه عامل، دیتاسنترها را به سیاهچالههایی تبدیل کرده که هر چه حافظه به آنها تزریق میشود، بلافاصله بلعیده میگردد.

۲. رنسانس مکانیکی: راز پیشخرید ظرفیت ۲۰۲۶ وسترن دیجیتال

شاید در نگاه اول متناقض به نظر برسد؛ در دورانی که حافظههای NVMe SSD با سرعتهای خیرهکننده و تاخیرهای نانوثانیهای بازار را تسخیر کردهاند، چرا غولهای فناوری (Hyperscalers) مانند آمازون (AWS)، مایکروسافت (Azure) و گوگل (GCP) برای خرید هارد دیسکهای مکانیکی (HDD) با یکدیگر میجنگند؟ چرا سیلیکونولی به تکنولوژیای که بسیاری آن را "منسوخ" میپنداشتند، بازگشته است؟ پاسخ در طبقهبندی استراتژیک دادهها، طول عمر سختافزار و اقتصاد مقیاس نهفته است.

گزارشهای معتبر زنجیره تامین در فوریه ۲۰۲۶ تأیید میکنند که شرکت Western Digital (وسترن دیجیتال)، به عنوان یکی از دو ستون اصلی تولید فضای ذخیرهسازی در جهان (در کنار سیگیت)، سفارشاتی دریافت کرده که عملاً تمام خروجی کارخانههای تولید هاردهای کلاس سازمانی (Enterprise-Class HDDs) این شرکت را تا پایان سال رزرو کرده است. دلیل این هجوم بیسابقه این است که در یک دیتاسنتر هوش مصنوعی، بر خلاف تصور عمومی، تنها ۲۰ درصد از دادهها نیازمند پردازش بلادرنگ هستند. حدود ۸۰ درصد از حجم اطلاعات را «دادههای سرد» (Cold Data) تشکیل میدهند. اینها شامل ویدیوهای خام، آرشیو چکپوینتها، لاگهای سیستمی و بکآپهای پایگاهدادههای برداری هستند که نیازی به پردازش لحظهای ندارند.

ذخیره کردن اگزابایتها (یک میلیون ترابایت) از این نوع دادهها روی حافظههای فلش (SSD)، از نظر اقتصادی و فنی یک خودکشی استراتژیک است. SSDها، به ویژه مدلهای مبتنی بر QLC و PLC که ظرفیت بالایی دارند، دارای محدودیت چرخه نوشتن (TBW - Terabytes Written) هستند. در محیط هوش مصنوعی که دادهها به طور مداوم نوشته، پاک و بازنویسی میشوند، یک SSD پرظرفیت ممکن است در کمتر از دو سال از کار بیفتد. اما هارد دیسکهای مکانیکی به دلیل استفاده از تغییرات قطبیت مغناطیسی، عملاً استهلاک نوشتن ندارند و میتوانند پتابایتها داده را به صورت متوالی و بدون افت کیفیت برای یک دهه ذخیره کنند.

غولهای ابری با پیشخرید کامل ظرفیت تولید وسترن دیجیتال، در واقع در حال ساختن یک «خندق اقتصادی» (Economic Moat) پیرامون پروژههای هوش مصنوعی خود هستند. آنها با این کار نه تنها امنیت بایگانی دادههای خود را تضمین میکنند، بلکه با ایجاد کمبود مصنوعی در بازار سختافزار، هزینه ورود رقبای کوچکتر و استارتاپها به بازار توسعه هوش مصنوعی را به شدت افزایش میدهند. این احتکار، یک بازی بیرحمانه در شطرنج سختافزاری جهان است که در آن برنده کسی است که دیتای بیشتری را ارزانتر ذخیره کند.

۳. فیزیک ذخیرهسازی: چگونه تکنولوژی HAMR معادلات را تغییر داد؟

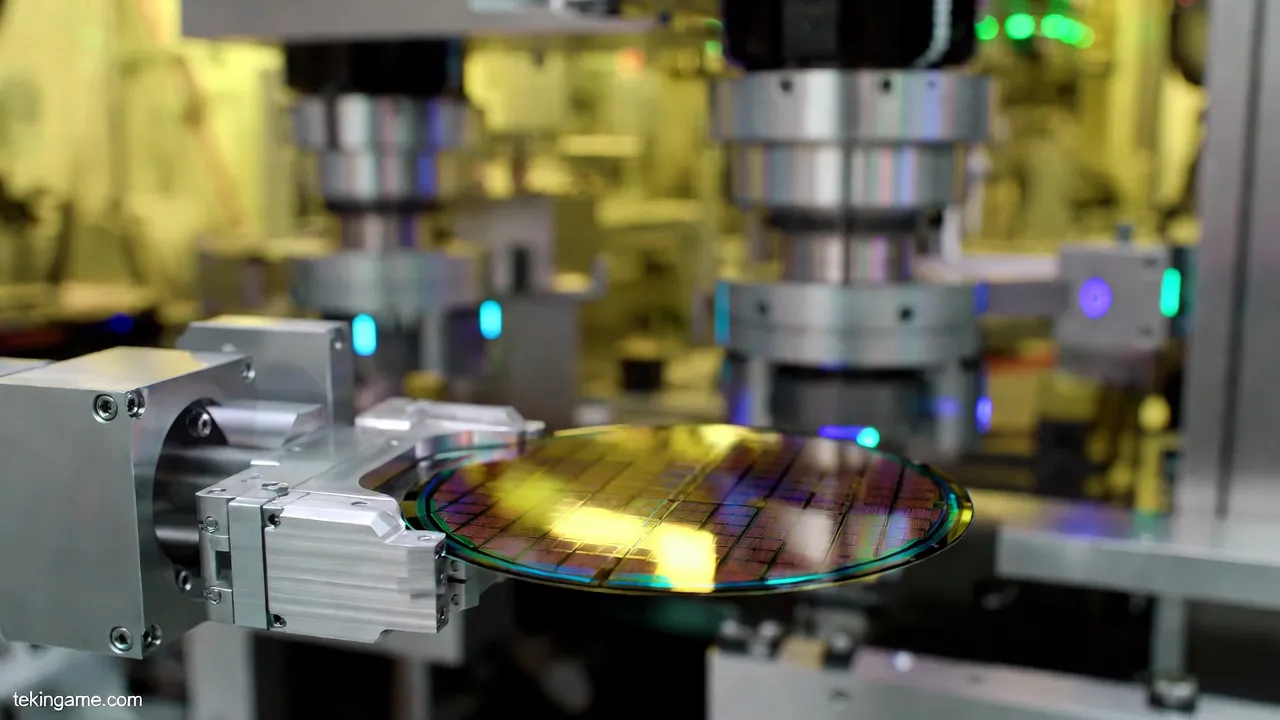

برای اینکه وسترن دیجیتال بتواند نظر غولهای فناوری را برای پیشخرید محصولاتش تا این حد جلب کند، صرفاً تولید هاردهای معمولی کافی نبود. آنها نیازمند یک جهش تکنولوژیک بودند. هارد دیسکهای ۲۰ ترابایتی سنتی که بر پایه ضبط مغناطیسی متعامد (PMR/CMR) ساخته میشدند، دیگر پاسخگوی تراکم فیزیکی دیتاسنترها نبودند. هزینه اجاره فضا، قفسهبندی (Racking) و خنککننده در دیتاسنترها به شدت بالاست و شرکتها به هاردهایی نیاز داشتند که در همان فرمفکتور استاندارد ۳.۵ اینچی، ظرفیتهای ۳۰ تا ۴۰ ترابایتی ارائه دهند.

اینجا بود که تکنولوژی HAMR (ضبط مغناطیسی به کمک حرارت - Heat-Assisted Magnetic Recording) و ePMR (ضبط مغناطیسی عمودی با کمک انرژی) وارد میدان شدند و قوانین فیزیک ذخیرهسازی را بازنویسی کردند. در یک هارد دیسک سنتی، وقتی میخواهید دادهها را متراکمتر بنویسید، بیتهای مغناطیسی (دامنهها) روی پلاتر به قدری کوچک و به هم نزدیک میشوند که پایداری خود را از دست میدهند. در این حالت، تغییر قطبیت یک بیت ممکن است باعث تغییر ناخواسته بیتهای مجاور شود؛ پدیدهای که در فیزیک به آن اثر سوپرپارامغناطیس (Superparamagnetic Effect) میگویند.

تکنولوژی HAMR این محدودیت فیزیکی را با ترکیب فیزیک کوانتومی، اپتیک و ترمودینامیک حل کرده است. در هاردهای جدید وسترن دیجیتال، هدِ نوشتن به یک قطعه فوقپیشرفته به نام مبدل میدان نزدیک پلاسمونیک (Plasmonic Near-Field Transducer) مجهز شده است که یک دیود لیزری میکروسکوپی در خود دارد. این لیزر در کسری از نانوثانیه، سطح پلاتر (که اکنون به جای آلومینیوم از جنس شیشه با پوششهای خاص است) را تا دمای بالای ۴۰۰ درجه سانتیگراد (نقطه کوری - Curie Point) گرم میکند.

این حرارت نقطهای باعث میشود مقاومت مغناطیسی رسانه برای لحظهای کوتاه از بین برود و به هد اجازه دهد دادهها را در فضایی به شدت کوچکتر و متراکمتر بنویسد. بلافاصله پس از نوشتن (در کمتر از یک نانوثانیه)، نقطه خنک شده و دادهها با پایداری مغناطیسی بسیار بالا به طور دائمی و امن ثبت میشوند. این دستاورد مهندسی باعث شده تا وسترن دیجیتال بتواند هاردهای ۳۰+ ترابایتی را تولید کند. توانایی ارائه این ظرفیت عظیم با مصرف انرژی پایین (به لطف پر شدن محفظه هارد با گاز هلیوم به جای هوا برای کاهش اصطکاک)، دقیقاً همان کاتالیزوری بود که مدیران ارشد فناوری (CTO) در سیلیکونولی را مجاب کرد تا انبارهای این شرکت را خالی کنند.

۴. هشدار قرمز فایسون: کنترلرهای SSD، گلوگاه جدید سیلیکون

در حالی که جبهه ذخیرهسازی سرد به طور کامل توسط هارد دیسکهای مکانیکی مدیریت میشود، جبهه ذخیرهسازی داغ (Hot Data) درگیر بحرانی به مراتب پیچیدهتر و تکنولوژیکتر است. K.S. Pua، مدیرعامل شرکت Phison (غول بلامنازع طراحی کنترلرهای SSD در جهان)، اخیراً در یک نشست سرمایهگذاری هشداری صادر کرده که لرزه بر اندام صنعت انداخته است: «بحران ذخیرهسازی هوش مصنوعی، میتواند سریعتر از کمبود پردازندهها، ماشین هوش مصنوعی را متوقف کند.»

مسئله در اینجا خودِ تراشههای حافظه (NAND Flash) نیستند؛ بحران اصلی در «کنترلرها» است. در دیتاسنترهای هوش مصنوعی که پردازندههای انویدیا در حال پردازش هزاران گیگابایت داده در ثانیه هستند، SSDها باید به عنوان یک پل ارتباطی مستقیم و بدون واسطه با حافظه گرافیکی عمل کنند. فناوریهایی مانند GPU Direct Storage (GDS) به پردازنده گرافیکی اجازه میدهند تا پردازنده مرکزی (CPU) را دور زده و دادهها را مستقیماً از روی SSD بخواند. برای مدیریت این حجم از ترافیک روی رابطهای جدید PCIe Gen 6، کنترلر SSD دیگر یک چیپ ساده نیست؛ بلکه یک ریزپردازنده چندهستهای بسیار قدرتمند است که نیازمند معماری پیچیده و نودهای پردازشی پیشرفته (Advanced Process Nodes) است.

مشکل صنعت دقیقاً در همین نقطه تلاقی میکند. برای ساخت کنترلرهایی که بتوانند سرعتهای بالای ۱۴ تا ۲۸ گیگابایت بر ثانیه را بدون ذوب شدن مدیریت کنند، شرکتهایی مثل فایسون باید به سراغ خطوط تولید ۳ و ۴ نانومتری شرکت TSMC بروند. اما این خطوط تولید قبلاً توسط غولهایی چون اپل، انویدیا، کوالکام و AMD کاملاً اشغال و پیشخرید شدهاند! رقابت بر سر ویفرهای سیلیکونی پیشرفته باعث شده تا تولید کنترلرهای SSD کلاسِ سازمانی با تاخیری فلجکننده و افزایش قیمت شدید روبرو شود.

بدون کنترلرهای پیشرفته فایسون، سریعترین تراشههای حافظه سامسونگ، اسکی هاینیکس و مایکرون نیز بیمصرف هستند. وقتی دیتا با سرعت کافی از حافظه به GPU نرسد، پردازندههای صدهزار دلاری هوش مصنوعی دچار حالت "بیکاری اجباری" (Idle Time) یا خفگی داده (Data Starvation) میشوند. هشدار مدیرعامل فایسون به این معناست: یک قطعه چند ده دلاری (کنترلر)، میتواند تمام سرمایهگذاریهای میلیارد دلاری انجام شده روی کلاسترهای پردازشی هوش مصنوعی را بیاثر کند.

۵. تحلیل TCO دیتاسنترها: تقابل اقتصادی HDD و SSD در مقیاس اگزابایت

برای اینکه عمق استراتژی خرید یکجای هاردهای وسترن دیجیتال را به طور کامل درک کنیم، باید مانند یک تحلیلگر ارشد مالی در والاستریت به هزینه کل مالکیت (TCO - Total Cost of Ownership) نگاه کنیم. در مقیاس دیتاسنترهای هوش مصنوعی، تصمیمات فنی مستقیماً با میلیاردها دلار بودجه در ارتباط هستند و احساسات هیچ نقشی در معماری سیستم ندارند.

دیتاسنترهای مدرن هوش مصنوعی از یک معماری ذخیرهسازی لایهبندی شده و هوشمند (Intelligent Tiered Storage) استفاده میکنند. SSDهای گرانقیمت NVMe با رابطهای شبکه CXL تنها برای دادههایی استفاده میشوند که پردازندهها در همان لحظه برای تغذیه تانسورکورها (Tensor Cores) به آنها نیاز دارند. اما بقیه اقیانوسِ دادهها، که حجم اصلی را تشکیل میدهد، باید روی ارزانترین رسانه ممکن با کمترین مصرف انرژی ذخیره شود. بیایید در یک جدول تحلیلی استاندارد تکین، هزینه ساخت و نگهداری یک زیرساخت ذخیرهسازی با ظرفیت یک اگزابایت (معادل یک میلیون ترابایت) را برای مدت زمان مفید ۵ سال مقایسه کنیم:

| معیار مقایسه (برای ظرفیت ۱ اگزابایت) | معماری تمام-فلش (۱۰۰٪ Enterprise NVMe SSD) | معماری هیبریدی بهینه (۸۰٪ HDD وسترن دیجیتال + ۲۰٪ SSD) |

|---|---|---|

| هزینه اولیه خرید سختافزار (CapEx) | حدود ۱۸۵ میلیون دلار | حدود ۵۸ میلیون دلار |

| مصرف انرژی و تجهیزات خنککننده (OpEx ۵ ساله) | بسیار بالا (نیازمند خنککننده مایع در سطح رک برای مهار حرارت Gen5/Gen6) | متوسط (هاردهای پرشده با هلیوم بهینگی مصرف برق بالایی دارند) |

| طول عمر نوشتن (TBW / Endurance) | محدود - نیاز به تعویض درایوها به دلیل بازنویسی مکرر لاگهای AI | نامحدود برای ضبط مغناطیسی، ایدهآل برای آرشیو متوالی پتابایتی |

| مجموع هزینه مالکیت استراتژیک (TCO) | بیش از ۲۲۰ میلیون دلار | حدود ۹۲ میلیون دلار |

همانطور که در تحلیلهای اقتصادی تکین به وضوح نشان داده شده است، استفاده از هارد دیسکهای مکانیکی وسترن دیجیتال در لایه آرشیو میتواند هزینههای یک دیتاسنتر را در مقیاس اگزابایت به کمتر از نصف کاهش دهد. در صنعتی که ساخت یک کلاستر هوش مصنوعی گاهی تا ده میلیارد دلار هزینه برمیدارد، صرفهجویی چند صد میلیون دلاری در بخش ذخیرهسازی به معنای بودجه بیشتر برای خرید گرافیکهای نسل جدید و جذب نخبگان هوش مصنوعی است. این منطق بیرحمانه ریاضی است که باعث شده وسترن دیجیتال در سال ۲۰۲۶ به پادشاه بلامنازع فروش زیرساخت آرشیوی تبدیل شود.

۶. پسلرزههای زنجیره تامین: پایان دوران حافظههای ارزان برای مصرفکننده

تصمیمات کلان در اتاقهای شیشهای هیئت مدیره در سیلیکونولی، امواج ویرانگری برای مصرفکنندگان عادی در سراسر جهان ایجاد کرده است. جنگ قدرت بین دیتاسنترها برای احتکار ظرفیتهای وسترن دیجیتال و بحران گلوگاه کنترلرهای فایسون، یک پیامد مستقیم، ملموس و تلخ برای بازار مصرفکننده (Consumer Market) به همراه دارد: پایان قطعی دوران ذخیرهسازی ارزانقیمت.

وقتی وسترن دیجیتال خطوط تولید خود را به طور کامل به مونتاژ هاردهای ۳۰ ترابایتی سازمانی اختصاص میدهد، تولید هاردهای ۴، ۸ و ۱۲ ترابایتی که معمولاً در سیستمهای خانگی، دستگاههای ضبط دوربینهای مداربسته (DVR/NVR) و سرورهای ذخیرهسازی متصل به شبکه خانگی (NAS) استفاده میشوند، به شدت کاهش مییابد. قانون ساده و خشن عرضه و تقاضا باعث شده تا قیمت هارد دیسکهای رده مصرفکننده در بازارهای جهانی رکوردهای جدیدی ثبت کند. کاربرانی که قصد راهاندازی یک آرشیو خانگی را دارند، اکنون باید مبالغی را پرداخت کنند که تا دو سال پیش غیرقابل تصور بود.

از سوی دیگر، هشدار فایسون در بازار SSDهای خانگی نیز خود را به شکل بیرحمانهای نشان داده است. سازندگان حافظه، بهترین تراشههای فلش خود را به سمت محصولات گرانقیمت سازمانی هدایت میکنند تا حاشیه سود خود را افزایش دهند. نتیجه این است که گیمرهایی که به دنبال خرید SSDهای پرسرعت M.2 برای ارتقای سیستمهای گیمینگ خود هستند، با کمبود شدید موجودی و قیمتهای نجومی مواجه شدهاند. طراحان سهبعدی، تدوینگران ویدیوهای 8K و استودیوهای مستقل که برای بایگانی پروژههای خود به هاردهای با ظرفیت بالا وابستهاند، اکنون باید بخش بزرگی از بودجه ارتقای سختافزار خود را صرف خرید ابزارهای ذخیرهسازی کنند. بحران هوش مصنوعی، عملاً هزینه توسعه زیرساخت را از جیب غولهای فناوری برداشته و به عنوان یک "مالیات پنهان سختافزاری" به کاربران عادی در سراسر جهان تحمیل کرده است.

۷. نتیجهگیری استراتژیک: مسابقه تسلیحاتی بر سر «نفتِ دیجیتال»

بحران حافظه در سال ۲۰۲۶ ثابت میکند که در عصر جدید فناوری، دادهها صرفاً یک محصول جانبی از پردازش نیستند؛ آنها به معنای واقعی کلمه «نفت دیجیتال» هستند. مدلهای هوش مصنوعی، موتورهای احتراقی این عصرند و دادهها سوخت آنهاست. هارد دیسکهای وسترن دیجیتال، بشکههایی هستند که این سوخت گرانبها در آنها ذخیره میشود و کنترلرهای فایسون، پمپهای فشار قویای هستند که این سوخت را به پالایشگاههای پردازشی انویدیا منتقل میکنند. پیشخرید کامل تولیدات یک سالِ یک غول تکنولوژی توسط چند شرکت معدود، نشان از یک مسابقه تسلیحاتی پنهان، جدی و بیرحمانه دارد.

استراتژی مشخص است: کسی که نتواند دادههای بیشتری را ذخیره و در زمان مناسب پردازش کند، در نبرد نهایی برای رسیدن به هوش مصنوعی عمومی (AGI - Artificial General Intelligence) قطعا شکست خواهد خورد. در حالی که محققان در آزمایشگاهها روی فناوریهای آیندهنگرانهای مانند ذخیرهسازی روی رشتههای DNA (DNA Data Storage) یا حکاکی داده روی کریستالهای کوارتز (Project Silica) کار میکنند، واقعیت میدانی این است که این تکنولوژیها هنوز در مرحله اثبات مفهوم (PoC) قرار دارند و حداقل یک دهه تا تجاری شدن در مقیاس صنعتی فاصله دارند.

در حال حاضر، صنعت فناوری روی لبه یک تیغ باریک حرکت میکند؛ نقطهای بحرانی که در آن سرعت تولید دادهها از سرعت توسعه رسانههای فیزیکی برای ذخیره آنها پیشی گرفته است. ارتش تکین به تمام استراتژیستهای فناوری، مدیران شبکههای سازمانی، طراحان زیرساخت و حتی کاربران حرفهای هشدار میدهد که برنامهریزیهای مربوط به ارتقای زیرساخت ذخیرهسازی خود را تسریع کنند. انتظار برای بازگشت قیمتها به دوران طلایی قبل از هوش مصنوعی، یک خطای استراتژیک محاسباتی است که میتواند به قیمت از دست رفتن رقابتپذیری تمام شود. در این نبرد جدید و ناشناخته، هر ترابایت فضای خالی، دیگر یک کالای مصرفی نیست، بلکه به یک دارایی حیاتی، کمیاب و تعیینکننده تبدیل شده است.